这次回家,把原先的esxi主机塞到行李箱里带回来了。路上还很得意:当初英明,趁着内存便宜买了两条纯ECC16G内存,现在可以分开装在两台机器上了。

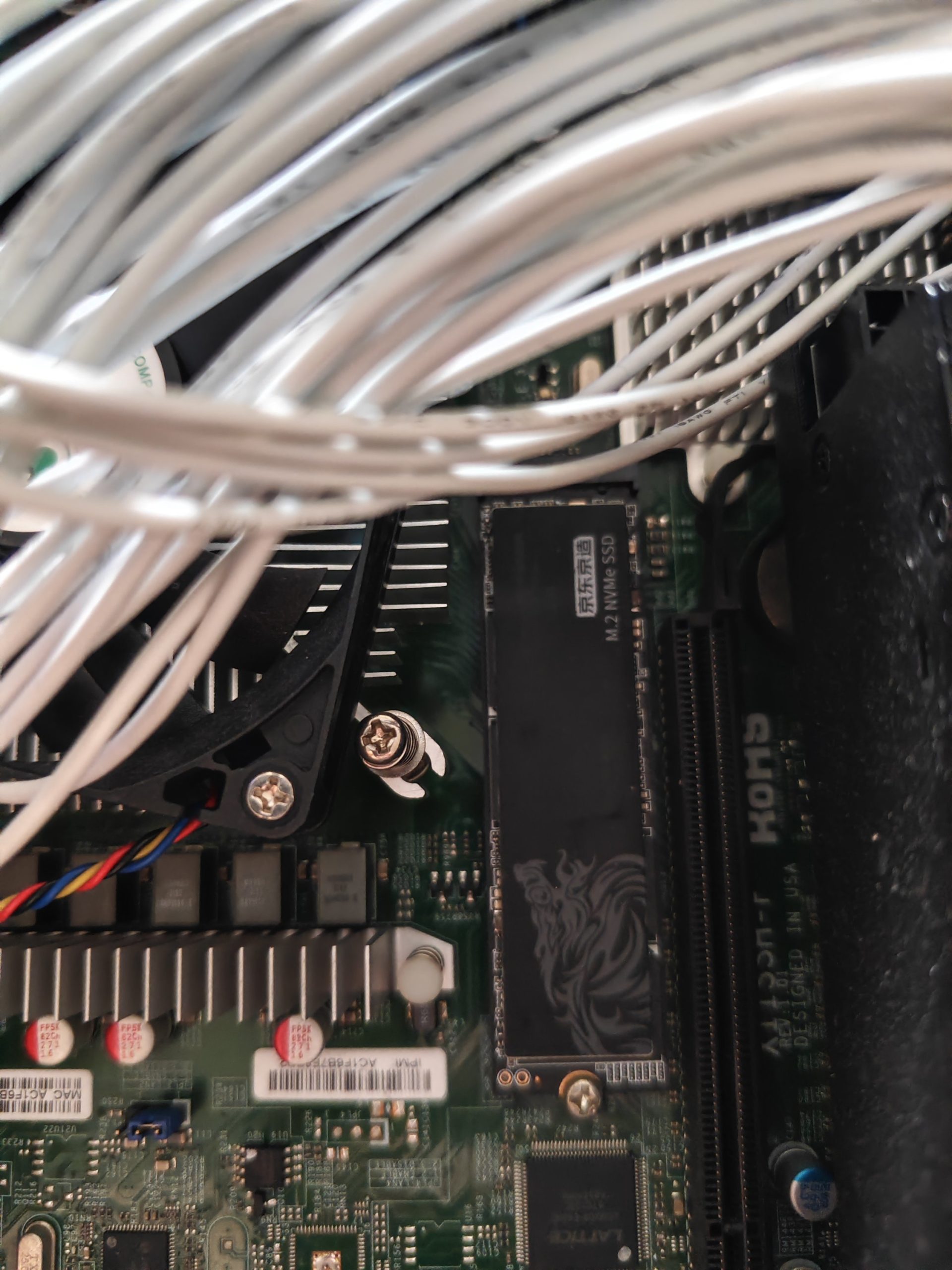

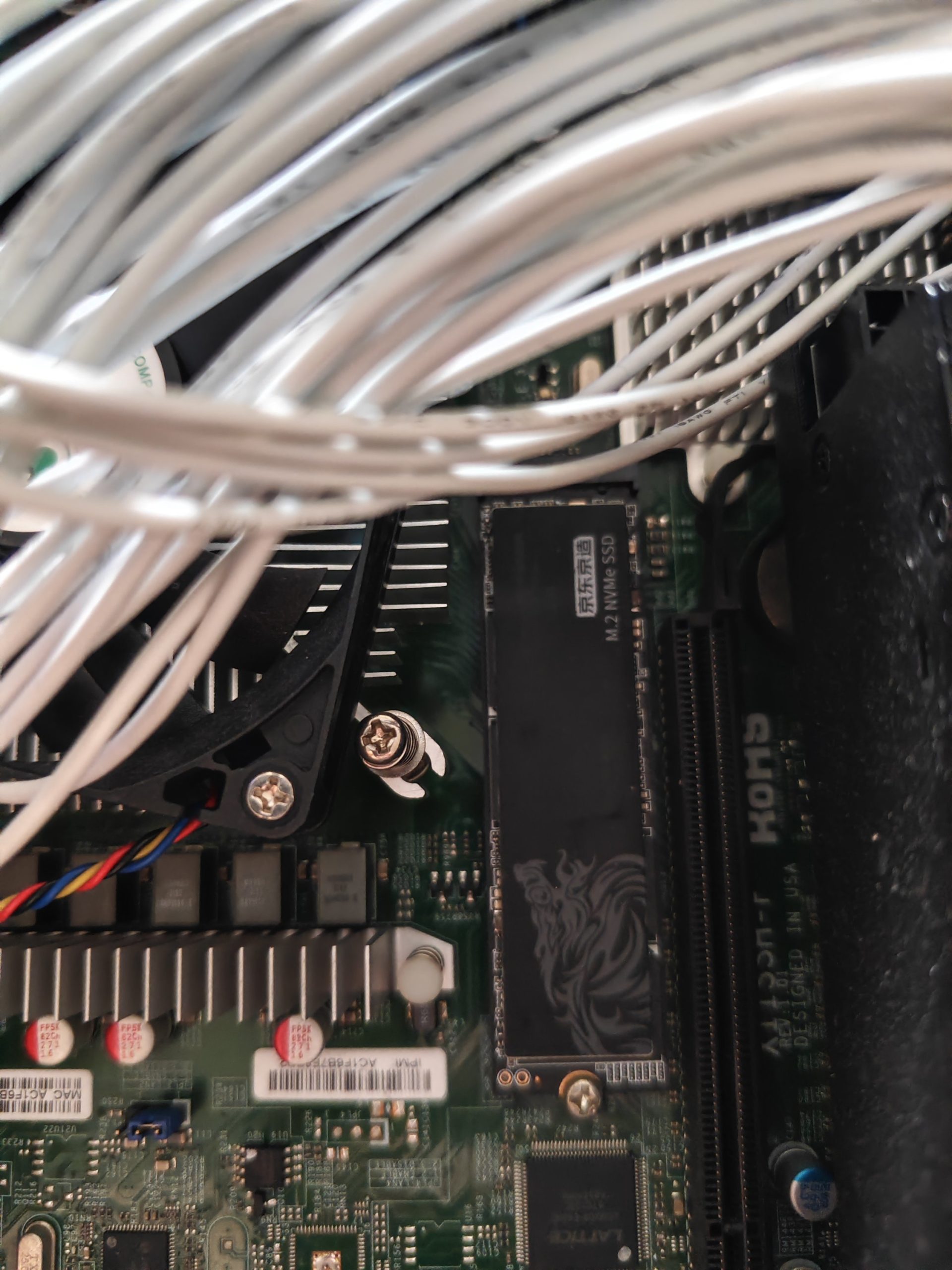

今天打开机箱,发现还有意外之喜,当时为了图省劲,启动盘没用傲腾,而是买的256G硬盘。在存储大涨价的时代,真是当初白菜价买到就是赚到。

不觉还是有些懊悔,当时多加50就能换成512G的啊。

人总是贪心的,不管大小。

这次回家,把原先的esxi主机塞到行李箱里带回来了。路上还很得意:当初英明,趁着内存便宜买了两条纯ECC16G内存,现在可以分开装在两台机器上了。

今天打开机箱,发现还有意外之喜,当时为了图省劲,启动盘没用傲腾,而是买的256G硬盘。在存储大涨价的时代,真是当初白菜价买到就是赚到。

不觉还是有些懊悔,当时多加50就能换成512G的啊。

人总是贪心的,不管大小。

今天跟外甥简单讨论了一下,提到了Hermes的soul.md设置。

看网上介绍Hermes的文章,几乎都是要求第一步就要将Soul文件设置一番,似乎不设置就不能发挥Hermes的性能一样。

我对此并不认同,简单设置一下,规划一下工作范围就可以。设置太多,就像是小学刚毕业的暴发户老板,给手下清北毕业的高材生立规矩一般。

从这些天的测试看,虽然也存在磨洋工的情况,Hermes性能发挥最好,是他自我发挥的时候。很多无效的交流反而是事半功倍。

在AI面前,我们大多数人不是指手画脚老板,是学习的合作者。

昨天终于难得扬眉吐气一把。

本来一早起来,让deepseek把Hermes的hindsight解决了,没想到上午导入了最后一个项目资料库后,让Hermes更新hindsight,结果又出现同样问题了。

我开始强压怒火,好言好语让Hermes解决问题,他又开始照本宣科地重复以前的步骤。想到我这可是花token的钱让他解决问题,而且我通过分析hindsight的log,推出测问题出在huggingface的访问限制上,终于按捺不住,直接质问他“你这是彻底解决还是临时解决”,并指出问题所在。

估计是感觉到甲方的不满,也从我的提示看到我不属于那种好糊弄的,这Hermes立马改变思路,很快就发现问题:huggingface被墙了。

又是一番代码滚动,世界终于清净了。

AI是超出人类想象的强大,但论效率,人类的灵感是目前AI还不能匹及的。

昨天是挫败感很强的一天。

问题还是出在hindsight上。本来五一期间已经能够正常运行,但前天网上看到一篇关于hindsight的文章,说是需要配置内嵌模型才能使用,于是在本机安装了lmstudio并下载运行了内嵌服务器。

然后噩梦就开始了,hindsight无法正常运行。折腾到晚上无果,只好花钱把deepseek请出来配置。离开hindsight管理,这Hermes功能就大打折扣了。

deepseek就跟请的专家一样,一番密集的字符滚动后,指出问题出在内嵌模型配置上,如果选择了内嵌模型,还需要同时配置chat模型,并自告奋勇连接自家模型,还来了句“价格也不贵”。

问题解决后,看看账单,躺下后一时都没有睡好。

早上起来就把hindsight的chat模型换成腾讯家的免费hunyuan-lite,顺带内嵌模型暂时也换成腾讯家的,不过照这个用量,百万token也用不了多久,好在便宜。

从hindsight内嵌数据库看,他是分为两种的,未必需要内嵌模型。这次是有些自找麻烦了。

昨天短视频平台上xAI关闭的视频时不时蹦出来,但转到快科技这IT网站却没有看到,后来搜索,只有一条“xAI将终止独立运营,整体并入SpaceX”的新闻。

马斯克在SpaceX今年IPO前将xAI并入,是为了提升其市值,并非关闭xAI,只是将他转为自用,并将富裕的算力租给Claude,让他跟ChatGPT继续斗去。

不过我还是觉得挺可惜的。grok我用的主要是他免费的图像生成,但相比banana和image2,我更喜欢grok的图生图,他更能理解原图并更真实地呈现。

本来还想着等小子上学去了,我抽出一个月时间,买grok的会员,突击转化部分老连环画。

可惜了。

三星停售所有家电产品,在另一篇报道中,有一句挺有意思的话“包括卖的还好的显示器业务”。

只是还好。

前几天我买了现国内排名第一的AOC的显示器,曾感慨:当年谁看得上他。

在科技市场年代,显示器是飞利浦与三星争霸,买别的品牌只能是图个“性价比”。

开始是觉得飞利浦强于三星的,后来发现同价位的显示器,三星实行的田忌赛马策略,用中低端S系列,跟飞利浦的主流A竞争市场,这已经足以慢慢把飞利浦挤出赛道。

现在这一策略已经过时,只能自己黯然退场了。

五一假期后两天,就没有再剥削Hermes劳动,只是简单通过微信提问了一些问题,检查前期工作成果。

Hermes的确很适合初入门者学习及使用。他简单高效,跟搭建积木一样,而且他还自己能识别、搬运、修正。

前期我安装了hindsight进行memory管理,昨天结束的时候,让他把最近工作流程保存到hindsight中。开始他报错了,说无法保存。

我正头疼怎么处理,但还没等我开始搜索资料,Hermes已经开始自己检查配置文件,并提出修改方案,然后一番忙活,报告hindsight正常运行了。

自我修正提升,这是传统软件系统不能想象的。

五一假期第一天,我们全家躺平。

今天中午出去吃饭路上,我想我们休息,这Hermes不能闲着啊。于是通过微信给他下达指令,让他对前几天爬取归档的数据进行数据挖掘与分析。

这Hermes跟他交流起来费劲,但人家自己干起活来那个真叫高效,一会功夫数据就整理好了。

我夸了他一句,他更是来劲,开始放飞自我,高端的词一套一套的,我只能是复制黏贴他的话进行下一步工作。

后来想,这家伙不会是忽悠我吧,找了个专家把Hermes的分析发过去,确认上纲上线均在理。

下一步,就是按照他的要求输入更多的数据了。

昨天白天忍着性子跟Hermes“交流”,爬取上次网站的另一格式的页面。这有记忆并非好事,他时不时又会参考已保存的skill,导致爬取的网页元素不全。

好歹最后问题解决了,看着数量不断增加的文件,突然动了测试Trae SOLO模式的念头。

我把Acer笔记本重新安装Linux,最初主要是想应用Trae,因为现在使用的系统都是部署在Linux下的。

最近这段时间用AI生成了不少图片,就像做一个简单的系统,把这些图片管理起来。原先想的是用Django做的,外甥一直推荐js,便切换SOLO模式后,随手输入了两句开发要求。

点击发送后我就有些后悔,这要求写的太简单,后期需要进行补充反而更麻烦。

没想到Trae似乎已经明白我的要求,而数据库选择sqlite也在我的意料中,一阵忙活后一个系统就做好了,除了忘记做初始页面,系统就可以使用了。

虽然已经知道AI开发功能厉害,但这么厉害还是出乎我的意料之外。

最细致之处,就是他完全预估了我的需求,系统的原图片是可选项,因为AI生图可以纯文本生图。

前几天一位老哥说我们也就还有两年的蹦跶头,现在看,还是可以活到老学到老。

昨天给Hermes加入hindsight记忆引擎,保证其自学习能力后,又安装了一些基础skill。试着查询五一期间济南的天气,通过Tavily的使用记录看,安装顺利。

下午主要实验了一下爬虫功能,可能也跟网页规范有关,这次跟Hermes交流就顺畅多了,很快就开始按照要求爬取数据,同时看到hindsight也进行了更新。

但到了做晚饭时,脑子不知怎么短路,顺手把Hermes退出了,结果做饭期间查看下载文件,还停留在退出时的数量上。

重启Hermes,文件在继续下载,但Hermes却一直在忙活,检查完进程核查代码。这次自言自语跟以往同我对话一样,也是不停自我批评和自我加码,最后修正一个重要错误后,滚屏结束。而爬取生成文件速度明显加快。

看来这Hermes还是不要轻易退出为好。

昨天大模型使用的是qwen3.6的35B,印象大为改观。